运行分析 数据处理与存储服务的核心价值与技术实践

在当今数据驱动的时代,无论是企业运营、科学研究还是个人应用,高效、可靠的数据处理与存储服务已成为不可或缺的基石。运行分析(Operational Analytics)作为实时或近实时地从业务运营数据中提取洞察的过程,其效能高度依赖于底层数据处理与存储架构的性能、弹性与智能化水平。本文旨在探讨支撑运行分析的数据处理与存储服务的关键维度、技术实践与未来趋势。

一、 数据处理服务:从流到洞察的引擎

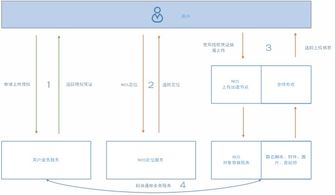

数据处理服务是将原始数据转化为可用信息和知识的核心环节。针对运行分析的低延迟要求,现代数据处理架构通常具备以下特征:

- 流批一体:融合流式处理(如Apache Flink, Apache Kafka Streams)与批处理(如Apache Spark)能力,实现对持续流入的数据进行实时计算,同时对历史数据进行深度挖掘,提供统一的分析视图。

- 弹性计算:基于云原生的容器化(如Kubernetes)与无服务器(Serverless)技术,计算资源能够根据数据流量和计算负载动态伸缩,在保证性能的同时优化成本。

- 智能处理:集成机器学习框架,使数据处理管道不仅能执行预定义的规则和聚合,还能进行实时异常检测、趋势预测与智能分类。

二、 数据存储服务:速度、规模与灵活性的平衡

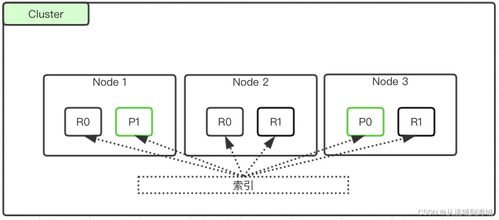

数据存储是运行分析的记忆体,其设计直接影响查询速度、数据一致性和系统扩展性。为满足多样化的分析需求,多层存储体系成为主流:

- 热存储层:面向实时查询,采用高性能的分布式内存数据库(如Redis, Memcached)或优化过的列式存储(如Apache Druid, ClickHouse),保障亚秒级响应。

- 温存储层:用于近线分析,通常依托于云对象存储(如AWS S3, Azure Blob Storage)与数据湖格式(如Delta Lake, Apache Iceberg),结合查询引擎(如Presto, Trino)实现性价比优异的交互式分析。

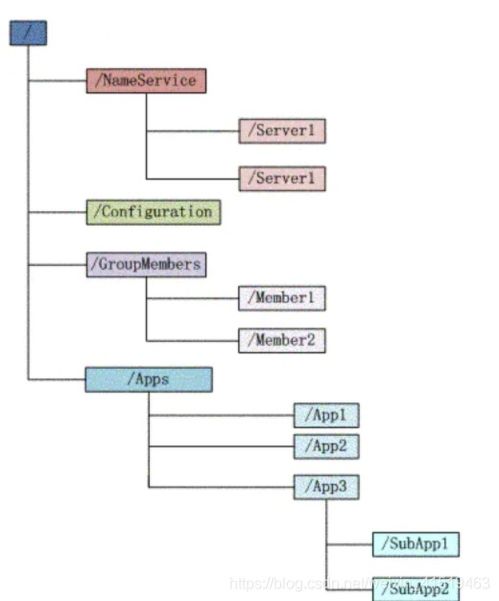

- 统一数据目录:通过元数据管理服务(如Apache Hive Metastore, AWS Glue Data Catalog)对分布在多层、多源的数据资产进行编目、发现和治理,确保数据可寻、可信、可用。

三、 核心挑战与一体化服务趋势

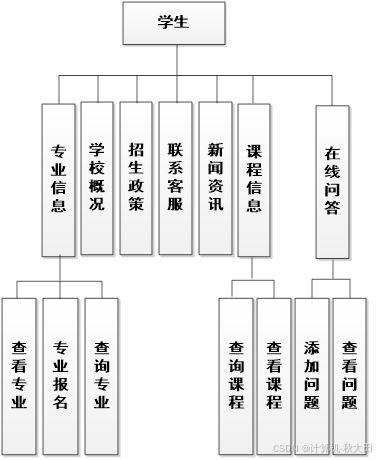

在实践中,运行分析面临数据孤岛、处理延迟、成本控制与运维复杂度等挑战。因此,业界呈现出向一体化、托管服务发展的趋势:

- 全托管服务:云厂商提供的端到端服务(如Google BigQuery, Snowflake, Azure Synapse Analytics)集成了从数据摄入、处理、存储到分析可视化的全链条能力,极大降低了技术门槛和运维负担。

- 湖仓一体(Lakehouse)架构:融合数据湖的灵活性与数据仓库的管理性能,通过开放格式在统一存储上同时支持BI、数据科学和实时应用,成为新一代数据平台的重要范式。

- 实时数仓:支持高并发、低延迟点查与复杂分析的实时数仓(如Apache Pinot),直接服务于用户画像、实时风控等场景,将分析延迟从小时/分钟级压缩至秒/毫秒级。

四、 未来展望

随着物联网、AI和边缘计算的普及,运行分析对数据处理与存储服务提出了更高要求:边缘节点预处理、中心云深度分析的双模架构;存储与计算更深度的解耦以极致优化成本;以及AI原生数据库的兴起,将智能(如向量检索、自动优化)更深地嵌入数据服务层。

一个健壮的数据处理与存储服务体系是释放运行分析价值的核心。组织需根据自身的延迟要求、数据规模、查询模式与技术栈,选择或构建合适的技术组合,并持续关注架构的演进,方能在数据洪流中精准锚定洞察,驱动决策与创新。

如若转载,请注明出处:http://www.starunicom.com/product/27.html

更新时间:2026-04-19 12:11:23